L’occhio umano, la fotocamera, l’artista

L’occhio umano? E’ una fotocamera con obiettivo fisso di 24mm, tempo di scatto pari a 1/100s, diaframma massimo pari a f/2.4, sensibilità variabile tra 1 e 1000 ISO, e risoluzione pari a 130 Megapixel.

Questi dati farebbero pensare ad una parentela stretta tra occhio e fotocamera. Al contrario, esistono molte e rilevanti differenze: i due sistemi “vedono” in modo sensibilmente diverso.

Questo spiega come mai le nostre fotografie, a volte, finiscano per deluderci perché non sono come le abbiamo “viste” al momento dello scatto.

Credo sia dunque importante approfondire e capire le differenze tra questi due sistemi ottici.

Anatomia dell’occhio

La luce che entra nell’occhio viene messa a fuoco dal cristallino sul “sensore dell’occhio”, cioè la retina.

Essa ha circa le stesse dimensioni di un sensore 24x36mm o full frame (diametro 32mm) ma è disposta in modo da seguire la curvatura dell’occhio. Ciò ne aumenta l’efficienza.

La retina è di estrema importanza, perché risulta collocata (come vedremo) a monte dell’intero sistema visivo umano. Ecco perché i controlli alla vista sono così importanti: l’obiettivo danneggiato della nostra reflex lo si può sempre sostituire, mentre l’occhio no!

L’immagine entrante viene proiettata rovesciata sul fondo della retina, proprio come nella fotocamera; ma le analogie finiscono qui. Vediamo perché.

Il sistema di messa a fuoco

Nella fotocamera, la messa a fuoco viene effettuata semplicemente muovendo il gruppo ottico dell’obiettivo, tramite rotazione di una ghiera posta sul barilotto.

Con l’occhio questo non è possibile; ma la natura ha inventato un procedimento geniale – sconosciuto a qualunque sistema ottico creato dall’uomo – che consiste nel modificare la forma del cristallino utilizzando i muscoli ciliari.

L’aumento o riduzione di questa curvatura, detta “accomodazione”, fa sì che l’occhio riesca a mettere a fuoco gli oggetti vicini in modo del tutto automatico. E inconscio.

Con l’età (dopo i 40 anni) il cristallino riduce la sua elasticità, e l’accomodazione perde efficacia: è il motivo per cui si fatica a mettere a fuoco un oggetto vicino, e subentra la presbiopia.

Il presbite, in sostanza, ha un “meccanismo di messa a fuoco automatica” non più efficiente… che va corretto con gli occhiali.

La macula

Ritornando a parlare della retina, va detto che la sua intera superficie non è efficiente in modo uniforme (come nei sensori digitali), ma esiste una zona centrale molto più sensibile di circa 6mm, detta macula, predisposta alla percezione del colore e dei dettagli.

Benché infatti l’angolo totale di visione del singolo occhio umano sia 90 gradi, i colori ed i dettagli sono di fatto riconoscibili solo all’interno di questo piccolo cono visivo che copre circa 25 gradi. La rimanente parte della retina “vede” quasi esclusivamente in bianco e nero, ed è in grado di percepire solo le forme ampie e il movimento.

La macula spiega anche come mai si dice comunemente che l’obiettivo “normale” (quello che “vede come l’occhio umano”) è un 50mm. Benché l’occhio nella sua interezza abbia una focale di 24mm, infatti, il cono visivo della macula corrisponde circa alla focale di 43mm (sempre con riferimento al full frame). 50mm quindi è una leggera sovrastima.

L’elaborazione dati

Sulla superficie della retina sono disposte circa 130 milioni di cellule fotosensibili (detti “coni” e “bastoncelli”). Esse hanno il compito di tradurre gli stimoli luminosi in segnali elettrici da inviare al cervello, attraverso il nervo ottico.

Va detto che solo una parte della moltitudine di dati fotometrici raccolta dalla retina viene passata al cervello: sia perché il nervo ottico è limitato nella quantità trasferibile, sia perché il cervello non riuscirebbe comunque ad elaborare tutto. Quindi possiamo dire che le capacità del “sistema ottico occhio” sono abbondantemente sovradimensionate rispetto a quelle del “chip di elaborazione dati”.

Nel cervello avviene una vera e propria “decodifica” dei dati, che arrivano da entrambi gli occhi in un flusso continuo. Coi suoi movimenti rapidissimi e subconsci (detti “saccadici”), l’occhio invia vere e proprie “scansioni” dell’ambiente… come fosse una telecamera che si sposta di continuo.

Non solo: il “diaframma” dell’occhio, la pupilla, si contrae o si dilata rapidamente per adeguarsi alla quantità di luce, per ogni punto di questa scansione visiva. In sostanza, l’occhio vede una singola scena con aperture di diaframma multiple – contrariamente alla fotocamera, dove è possibile selezionarne solo una alla volta.

Nella decodifica di questo flusso di informazioni, il cervello si avvale della memoria. Questa operazione influenza pesantemente il risultato finale; e, per capirlo, basta considerare ad esempio che:

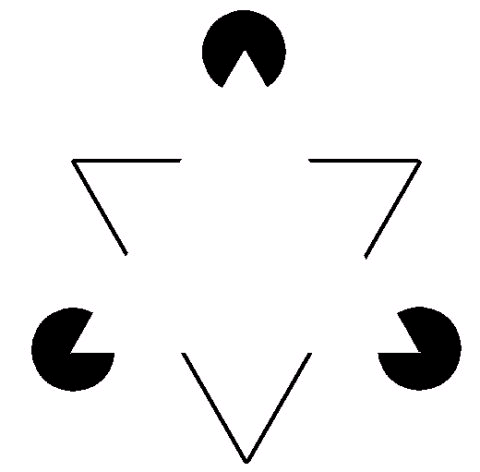

- Il cervello ricostruisce la visione mancante nel punto cieco della retina dove è presente il nervo ottico (vedi figura a inizio pagina).

- Il cervello “raddrizza” le linee cadenti (quelle che tanto ci infastidiscono nelle fotografie di architettura): l’occhio le registra erroneamente, ma il cervello le corregge, perché la nostra esperienza (memoria) considera verticali i muri di una casa.

- Il cervello ricostruisce sempre un’immagine tutta a fuoco, grazie ai rapidi movimenti di scansione degli occhi. L’esperienza del teleobiettivo, per capirci, è sconosciuta al sistema visivo organico.

- Il cervello fornisce persino un colore agli oggetti nei nostri sogni, quando le palpebre sono chiuse.

- Il cervello arriva anche a stravolgere la realtà:

La famosa illusione ottica qui sopra ci dimostra come il cervello “veda” due triangoli, quando in realtà non ve n’è disegnato nemmeno uno. Si deve ad una tendenza organizzativa innata nel nostro apparato percettivo, legata alla presenza del triangolo nel nostro vissuto esperienziale. La forma non esiste, ma per noi – nel momento in cui la guardiamo – sì.

Le conseguenze

Cosa possiamo quindi dedurre?

Che, come sperimenta chiunque faccia fotografia, le differenze tra sistema visivo umano e fotocamera sono tali che il primo “integra” pesantemente la realtà vista dalla fotocamera. (E senza considerare che quest’ultima “vede” in 2D, e non in 3D).

Per esempio può capitare (e capita spesso) che la nostra visione della realtà sia arricchita da determinati ricordi, dalla predetta tendenza “gestaltica”, o comunque situazioni non visuali. Percepiamo quindi un qualcosa che è “molto più” di quanto in realtà sia.

Quando premiamo il pulsante di scatto, siamo convinti di “intrappolare” nella fotocamera anche questi addendum; ma il risultato sarà invece quello di una fotografia “che mi sembrava così bella quando l’ho scattata, e invece…”.

Questo accade perché l’occhio è un mezzo di registrazione soggettivo, mentre la fotocamera è oggettivo.

La fotocamera non ha anima (intesa come “la capacità di provare emozioni e trasferirle all’immagine”)… quindi è compito del fotografo sopperire a questa carenza, per far sì che la visione della fotocamera si avvicini a quella del suo occhio. E’ una responsabilità propria dell’artista.

E come vi può riuscire? Utilizzando tutti gli strumenti che la fotografia mette a disposizione; sia prima dello scatto (scelta dell’inquadratura, scelta della profondità di campo, mosso, ecc.) che in post produzione (enfasi del colore, scelta di un ritaglio, modifica al contrasto, ecc.).

Fonti:

- Simone Conti, “L’occhio del fotografo – differenze e similitudini tra vista e fotografia”, fotografiaprofessionale.it

- Bruce Barnaum, “The art of photography”, Rockynook

- http://petapixel.com/2012/11/17/the-camera-versus-the-human-eye/

- http://www.marcofama.it/che-differenza-ce-tra-una-macchina-fotografica-locchio-umano/

- http://www.luminous-landscape.com/columns/eye-camera.shtml

- http://hyperphysics.phy-astr.gsu.edu/hbase/hframe.html

- http://www.luminous-landscape.com/tutorials/what_we_see.shtml

- http://www.nadir.it/pandora/OCCHIO_FOTOCAMERE/dassio.htm

- http://www.fisica.unige.it/~tuccio/SSIS/visione.html